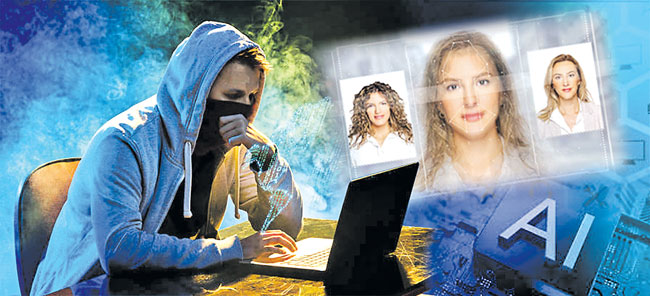

ఏఐతో ఏ‘మార్చేస్తారు’..!

‘వాట్సప్ తెరిచిన యువతి తెలియని నంబరు నుంచి వచ్చిన తన నగ్న ఫొటోలను చూసి ఆందోళనకు గురైంది. వాటిని ఎవరు తీశారు, ఎలా తీశారో తెలియక ఆయోమయానికి గురైంది.

డీప్ఫేక్తో తలకిందులవుతున్న జీవితాలు

సెలబ్రిటీల నుంచి సామాన్యుల దాకా బాధితులు

ఈనాడు, హైదరాబాద్: ‘వాట్సప్ తెరిచిన యువతి తెలియని నంబరు నుంచి వచ్చిన తన నగ్న ఫొటోలను చూసి ఆందోళనకు గురైంది. వాటిని ఎవరు తీశారు, ఎలా తీశారో తెలియక ఆయోమయానికి గురైంది. కొద్దిసేపటికి తాను అడిగినంత డబ్బు ఇవ్వకపోతే ఫొటోలను ఆమె స్నేహితులకు, వెబ్సైట్లలో పెడతానని సందేశం వచ్చింది. దీంతో బెంబేలెత్తిపోయిన యువతి కుటుంబసభ్యుల సహకారంతో సైబర్ పోలీసులను ఆశ్రయించింది. దర్యాప్తు చేపట్టిన పోలీసులు హుస్సేనీఆలాం పోలీస్స్టేషన్ పరిధిలో నివాసం ఉంటున్న మనీష్వర్మను అరెస్టు చేశారు. ఇన్స్టాగ్రామ్లో ఆ యువతి పెట్టుకున్న ఫొటోలను డీప్ఫేక్ సాయంతో నగ్నంగా మార్చినట్లు తెలిసింది.’

‘హైదరాబాద్కు చెందిన ఓ ఉద్యోగి అతడి స్నేహితుడు ఫోన్ చేసి అడగడంతో రూ.40 వేలు ఆన్లైన్లో పంపాడు. వేరే ఫోన్ నంబరు నుంచి చేసినా తన స్నేహితుడి గొంతే కావడంతో అనుమానించలేదు. కొద్దిరోజులకు అప్పు తీర్చమని అడిగినప్పుడు కానీ అసలు విషయం తెలియలేదు. సైబర్ నేరగాళ్లు ఏఐ సాయంతో తన స్నేహితుడి మాదిరిగా గొంతు మార్చి ఫోన్లో మాట్లాడారని.’

డీప్ఫేక్.. నేరప్రవృత్తి కలిగిన వారికి ఆయుధంగా మారుతుండగా, సామాన్యులు, సెలబ్రిటీల జీవితాలను అతలాకుతలం చేస్తోంది. ఈ మధ్యకాలంలో చోటు చేసుకుంటున్న ఉదంతాలే ఇందుకు నిదర్శనం. గతంలో ఫొటోలను మార్ఫింగ్ మాత్రమే చేసేవారు నేరగాళ్లు.. ఇప్పుడు కృత్రిమమేధ(ఏఐ) సాయంతో వీడియో, ఆడియోలను కూడా తమకు కావాల్సినట్లు మార్చుకుంటున్నారు. వాటి ద్వారా జనాల్ని బెదిరించి డబ్బులు డిమాండ్ చేస్తున్నారు. అందుబాటులోకి వస్తున్న ఏఐ సాఫ్ట్వేర్లు, యాప్లు నేరగాళ్లకు వరంలా మారాయి.

ఎలా చేస్తున్నారు..?

ఫొటోలు, వీడియోల్లోని వ్యక్తులను డీప్ఫేక్తో మరొకరిగా మార్చవచ్చు. జనరేటివ్ అడ్వర్సియల్ నెట్వర్క్(జీఏఎన్) విధానం ద్వారా ఓ ఫొటో, వీడియోల్లోని వ్యక్తుల ముఖ కవళికలు, గొంతును సేకరించి వేరే ఫొటో, వీడియోల్లోని వారికి కుదర్చడం దీని ప్రత్యేకత. తీక్షణంగా చూస్తే తప్ప నకిలీదని తెలియదు. కొంతకాలం క్రితం సినీనటి రష్మిక వీడియోను కూడా ఇలానే మార్చి సామాజిక మాధ్యమాల్లో పెట్టడం దేశవ్యాప్తంగా సంచలనం సృష్టించిన సంగతి విదితమే.

ఎలా తెలుసుకోవాలి?

- ఏఐతో చేసిన వీడియోను జాగ్రత్తగా గమనిస్తే బొమ్మ అదురుతున్నట్లు ఉంటుంది.

- చిత్రంలోని కాంతిలో హెచ్చుతగ్గులు ఉంటాయి.

- పలుకుతున్న మాటలు, పెదవుల కదలికలకు మధ్య వ్యత్యాసం ఉంటుంది.

- కనురెప్పల కదలికలు అసంబద్ధంగా ఉంటాయి.

అప్రమత్తతతో అడ్డుకోవచ్చు

ఏఐ సాయంతో చేసే మోసాలను అప్రమత్తతతో అడ్డుకోవచ్చు. సామాజిక మాధ్యమాల్లో పెట్టే ఫొటోలు, వీడియోల విషయంలో జాగ్రత్తగా ఉండాలి. వాటిని ఇతరులు చూడకుండా లాక్ పెట్టుకోవాలి. డబ్బు కావాలంటూ తెలిసిన వారి పేరుతో ఫోన్ వస్తే వారి మాటల్లో వ్యత్యాసం గమనించాలి. గొంతు ఒకే మాదిరిగా ఉన్నా యాస, పదాలు పలికే తీరులో మార్పులను గమనించాలి. ఎవరైనా తెలిసిన వ్యక్తి పేరుతో ఫోన్ చేసి బ్యాంకు ఖాతా, క్రెడిట్, డెబిట్ కార్డుల పిన్ నంబర్లు, ఓటీపీలు వంటివి అడిగితే అనుమానించాలి. ఒకవేళ ఎవరైనా డీప్ఫేక్ బారినపడితే వెంటనే పోలీసులకు ఫిర్యాదు చేయాలి.

పాటిబండ్ల ప్రసాద్, సైబర్ నేరాల దర్యాప్తు నిపుణులు, దిల్లీ

Trending

గమనిక: ఈనాడు.నెట్లో కనిపించే వ్యాపార ప్రకటనలు వివిధ దేశాల్లోని వ్యాపారస్తులు, సంస్థల నుంచి వస్తాయి. కొన్ని ప్రకటనలు పాఠకుల అభిరుచిననుసరించి కృత్రిమ మేధస్సుతో పంపబడతాయి. పాఠకులు తగిన జాగ్రత్త వహించి, ఉత్పత్తులు లేదా సేవల గురించి సముచిత విచారణ చేసి కొనుగోలు చేయాలి. ఆయా ఉత్పత్తులు / సేవల నాణ్యత లేదా లోపాలకు ఈనాడు యాజమాన్యం బాధ్యత వహించదు. ఈ విషయంలో ఉత్తర ప్రత్యుత్తరాలకి తావు లేదు.

మరిన్ని

-

ఆగస్టు 5 నుంచి 10 వరకు గోల్కొండ, శాతవాహన ఎక్స్ప్రెస్ల రద్దు

గోల్కొండ, శాతవాహన ఎక్స్ప్రెస్లతో పాటు సికింద్రాబాద్-పుణె మధ్య తిరిగే శతాబ్ది సహా పలు రైళ్లను నిర్మాణ, నిర్వహణ పనుల కారణంగా కొద్ది రోజులపాటు రద్దు చేసినట్లు దక్షిణ మధ్య రైల్వే తెలిపింది. -

తెలంగాణలో కొత్తగా మరో 9 వేల బీటెక్ సీట్లు..!

రాష్ట్రంలో కొత్తగా మరో 9 వేల వరకు బీటెక్ సీట్లు అందుబాటులోకి రానున్నాయి. ఈ నెల 26 నుంచి రెండో విడత ఇంజినీరింగ్ కౌన్సెలింగ్ మొదలవుతుంది. -

అనాథలా తల్లి శవం.. ఆస్తుల కోసం కుమార్తెల పంతం

ఆస్తుల కోసం తల్లి మృతదేహాన్ని అనాథగా వదిలేసి కుమార్తెలు వాగ్వాదానికి దిగిన ఘటన సూర్యాపేట జిల్లా కోదాడ పట్టణంలో గురువారం చోటుచేసుకుంది. -

కోకాపేట వరకు మెట్రోరైలు.. రెండోదశ ప్రతిపాదనలు సవరించిన తెలంగాణ ప్రభుత్వం

రాజధానిలోని మెట్రోరైలు రెండోదశలో దూరం, అంచనా వ్యయాలు పెరిగాయి. 5 కారిడార్లలో 70 కి.మీ. దూరం గతంలో ప్రతిపాదించగా ఇప్పుడు అది 8.4 కి.మీ. పెరిగి 78.4 కి.మీ. అయింది. -

సేద్యానికి పండగ.. సంక్షేమం నిండుగా..

తెలంగాణ రాష్ట్రం ఏర్పడిన తరవాత తొలిసారి అధికారంలోకి వచ్చిన కాంగ్రెస్ పార్టీ ప్రభుత్వం శాసనసభలో ప్రవేశపెట్టిన పూర్తిస్థాయి బడ్జెట్లో పేదల సంక్షేమం, సేద్యానికి అగ్రతాంబూలం ఇచ్చింది. -

సైబరాసురులకు చుక్కలే!

రాష్ట్రంలో సైబర్ నేరాలు, మాదకద్రవ్యాల వినియోగం ఆందోళనకరంగా పెరుగుతున్న నేపథ్యంలో వాటి కట్టడికి ఈ రెండు విభాగాలకు బడ్జెట్లో నిధులను పెంచారు.మొత్తమ్మీద హోం శాఖకు గతేడాది సవరించిన అంచనాల కంటే ఈసారి కాస్త తక్కువగా నిర్వహణ పద్దును కేటాయించారు. -

అప్పులపై ఆందోళన!

పెరిగిన రుణభారంపై సామాజిక, ఆర్థిక నివేదిక ఆందోళన వ్యక్తం చేసింది. వచ్చే ఆదాయానికి తగ్గట్లుగా ఖర్చును సమతుల్యం చేయాల్సి ఉందని.. అప్పులపై ఆధారపడటాన్ని తగ్గించాల్సిన అవసరం ఉందని పేర్కొంది. -

తితిదే అదనపు ఈఓగా వెంకయ్యచౌదరి

తిరుమల తిరుపతి దేవస్థానం అదనపు ఈఓగా సీహెచ్ వెంకయ్యచౌదరిని నియమిస్తూ ప్రభుత్వ ప్రధాన కార్యదర్శి నీరబ్కుమార్ ప్రసాద్ గురువారం ఉత్తర్వులు జారీ చేశారు. -

పుణ్యజలం.. ఇలా కలుషితం..

‘అన్నిటినీ కలుపుకొని.. మౌనంగా నీలోనే దాచుకొని.. గంభీరంగా కడలి వైపు కదిలావే గోదావరి.. బతుకుదారి తెలిపావే గోదావరి’ అనే పాట గుర్తుకు తెస్తోంది గోదావరిలో టన్నులకొద్దీ చేరే చెత్తాచెదారం. -

నీట్ నుంచి తెలంగాణ ప్రభుత్వం వైదొలగాలి

నీట్ నుంచి తెలంగాణ ప్రభుత్వం వైదొలగాలని, తాము వైదొలుగుతున్నట్లు సీఎం రేవంత్రెడ్డి శాసనసభలో తీర్మానం చేయాలని భారాస సీనియర్ నేత, మాజీ ఎంపీ వినోద్కుమార్ కోరారు. -

సంక్షేమం.. సంపన్నం!

ఎస్సీ, ఎస్టీ, బీసీ, మైనార్టీ వర్గాల సంక్షేమానికి రాష్ట్ర ప్రభుత్వం బడ్జెట్లో పెద్దపీట వేసింది. సంక్షేమశాఖల వారీగా అన్ని రంగాలకు ప్రాధాన్యం ఇచ్చింది. -

పల్లెకు పెన్నిధి

ఆసరా పథకాన్ని ‘చేయూత’ పేరుతో అమలుచేయాలని కాంగ్రెస్ ప్రభుత్వం నిర్ణయించింది. పెన్షన్ల కోసం ప్రభుత్వం ప్రస్తుతం రూ.12,000 కోట్లను ఏటా వెచ్చిస్తోంది. -

పెరిగిన ద్రవ్యలోటు

రాష్ట్ర ఆర్థిక ద్రవ్యలోటు ఏటా పెరుగుతోంది. వ్యయానికి తగ్గ ఆదాయం లేకపోతే ఏర్పడే అంతరాన్ని ‘ఆర్థిక ద్రవ్యలోటు’గా పిలుస్తారు. దీన్ని పూడ్చుకోవడానికి ప్రభుత్వం రుణాలు సేకరిస్తుంది. -

గ్యాస్ రాయితీకి నిధుల ‘గ్యారంటీ’

కాంగ్రెస్ పార్టీ ‘ఆరు గ్యారంటీ హామీ’ల్లో ఒకటైన ‘రూ.500కు గ్యాస్ సిలిండర్ పథకా’నికి రాష్ట్ర ప్రభుత్వం బడ్జెట్లో రూ.723 కోట్ల నిధుల్ని ప్రతిపాదించింది. -

విశ్వవిద్యాలయాలకు రూ.500 కోట్లే!

రాష్ట్రంలోని విశ్వవిద్యాలయాల్లో మౌలిక వసతులు లేవు. హాస్టళ్లు తగినన్ని లేవు. పాతబడిన భవనాలు ఎప్పుడు కూలిపోతాయో అన్న ఆందోళన విద్యార్థులను వెంటాడుతోంది. ప్రభుత్వాలు మాత్రం అభివృద్ధి పనులకు అరకొర నిధులు కేటాయించి చేతులు దులిపేసుకుంటున్నాయి -

ప్రాధాన్య ప్రాజెక్టులకే నిధులు

బడ్జెట్లో ప్రాధాన్య ప్రాజెక్టులకు రాష్ట్ర ప్రభుత్వం పెద్దపీట వేసింది. నీటి పారుదల రంగానికి రూ.22,301 కోట్ల కేటాయింపులు చేయగా రుణాలకు వడ్డీలు, జీతభత్యాలు పోను నిర్మాణాలకు రూ.10,828.84 కోట్లు కేటాయించారు. -

విద్యాశాఖకు కాస్త పెంచినా..

రాష్ట్రంలో విద్యాశాఖకు బడ్జెట్లో ఈసారి రూ.21,292 కోట్లు ప్రతిపాదించారు. గత ఏడాది రూ.19,093 కోట్లు కాగా.. ఈసారి రూ.2199 కోట్లు పెంచారు. 2021-22 తర్వాత ఇదే అధికం. -

విద్యుత్కు నిధుల వెలుగులు

నిరంతర విద్యుత్ సరఫరా అందించడమే లక్ష్యంగా రాష్ట్ర బడ్జెట్లో ప్రభుత్వం భారీగా నిధులు కేటాయించింది. గతేడాది(2023-24) బడ్జెట్లో తొలుత రూ.12,727 కోట్లే కేటాయించింది. -

మహానగరికి నిధుల భాగ్యం

హైదరాబాద్ మహానగరం అభివృద్ధిపై తెలంగాణ ప్రభుత్వం ప్రత్యేక దృష్టి సారించింది. రాష్ట్ర బడ్జెట్లో నగరాభివృద్ధికి భారీగా నిధులు కేటాయించింది. -

సొంత రాబడులపై భారీ అంచనాలు

సొంత పన్నుల రాబడిలో గణనీయమైన వృద్ధి రేటును ఆశిస్తూ రాష్ట్ర ప్రభుత్వం భారీ పద్దును ప్రతిపాదించింది. పన్నేతర ఆదాయంపైనా కొండంత నమ్మకంతో పథకాలకు నిధులు కేటాయించింది. -

బడ్జెట్పై మంత్రుల స్పందనలు ఇవీ..

రాష్ట్ర బడ్జెట్ను పౌరసరఫరాలు, నీటిపారుదలశాఖల మంత్రి ఉత్తమ్కుమార్రెడ్డి స్వాగతించారు. హైదరాబాద్ అభివృద్ధికి రూ.10 వేల కోట్లు కేటాయించడం ద్వారా ప్రపంచస్థాయి నగరంగా మార్చేందుకు బడ్జెట్లో స్పష్టమైన విజన్ ఉందని ప్రశంసించారు.

తాజా వార్తలు (Latest News)

-

రైటర్గా నాని.. జోరందుకున్న ప్రచారం

-

తెదేపా కొనసాగి ఉంటే 2021లోనే పోలవరం పూర్తయ్యేది: సీఎం చంద్రబాబు

-

ఈనాడు.నెట్లో టాప్ 10 వార్తలు @ 1 PM

-

గోదావరిలో నీరుంది.. కానీ ప్రభుత్వానికి ఇచ్చే మనసు లేదు: కేటీఆర్

-

ఐటీఆర్ దాఖలు గడువు పొడిగింపు లేనట్లేనా?

-

మదనపల్లెలో బాధితుల నుంచి అర్జీలు స్వీకరించిన సిసోదియా