డీప్ఫేక్... మాయలో పడొద్దు!

నిప్పుతోనూ నీటితోనూ చెలగాటమాడలేం. అవి ఎంత అవసరమైనవో అంత ప్రమాదకరమైనవి కూడా. అందుకే అప్రమత్తంగా ఉంటాం. ఇప్పుడు మనకి అందుబాటులోకి వస్తున్న రకరకాల సాంకేతికతలూ అలాంటివే. ఎంత మేలుచేస్తాయో అంత కీడూ చేయగల శక్తి వాటికి ఉంది.

నిప్పుతోనూ నీటితోనూ చెలగాటమాడలేం. అవి ఎంత అవసరమైనవో అంత ప్రమాదకరమైనవి కూడా. అందుకే అప్రమత్తంగా ఉంటాం. ఇప్పుడు మనకి అందుబాటులోకి వస్తున్న రకరకాల సాంకేతికతలూ అలాంటివే. ఎంత మేలుచేస్తాయో అంత కీడూ చేయగల శక్తి వాటికి ఉంది. మరి వాటి విషయంలోనూ మనం అంత జాగ్రత్తగా ఉంటున్నామా..? ఇటీవల వార్తల్లోకి వస్తున్న ‘డీప్ఫేక్’ ఈ దిశగా ఎన్నో హెచ్చరికలు చేస్తోంది.

ఉన్నది లేనట్లూ లేనిది ఉన్నట్లూ కన్పించే మయసభ గురించీ... సృష్టికే ప్రతిసృష్టిలాంటి త్రిశంకు స్వర్గం గురించీ... చదువుకున్నాం.

కానీ...ముఖం ఒకరిదైతే శరీరం వేరొకరిది కావడం, మాట ఒకరిదైతే రూపం మరొకరిది కావటం...ఇప్పుడే వింటున్నాం. మోసం చేసే నైజం ఉన్నవారిని ‘తలకాయలు మార్చే రకం’ అంటారు. ఇప్పుడదే పెద్ద మోసంగా తయారైంది. రశ్మిక, తమన్నా, కాజోల్, కత్రినా... లాంటి సెలెబ్రిటీలే కాదు, డీప్ఫేక్ బాధితులు ఎవరైనా కావచ్చు. సాక్షాత్తూ ప్రధాని మోదీ పాట పాడుతున్నట్లు వచ్చిన వీడియోనీ చూశాం కదా.

2020 ఎన్నికల సమయంలో అమెరికా అధ్యక్షుడు జో బైడెన్ పలుమార్లు దీని బారిన పడ్డారు. మాజీ అధ్యక్షులు బరాక్ ఒబామా, డొనాల్డ్ ట్రంప్, రష్యా అధ్యక్షుడు పుతిన్, ఉక్రెయిన్ అధ్యక్షుడు జెలెన్స్కీ... ఎవరూ మినహాయింపు కాదు. ఆమధ్య బిల్గేట్స్ని ఓ జర్నలిస్టు చాలా సీరియస్ ప్రశ్నలు అడిగి ఇబ్బందిపెడుతున్నట్లు ఒక వీడియో వచ్చింది. అది చూసి చాలామంది ‘భలే అడిగారే’ అనుకున్నారు. అది డీప్ఫేక్ అని తెలిశాక విస్తుపోయారు. గబన్ అనే ఆఫ్రికా దేశంలో అధ్యక్షుడి ప్రసంగం వీడియో చూసి ఆ దేశ సైన్యం మిలిటరీ చర్యకు ఉపక్రమించబోయింది. అదృష్టవశాత్తూ అది నకిలీ అని త్వరగా తెలియడంతో విరమించుకుంది. అదీ డీప్ఫేక్ సత్తా. సినిమా హీరో హీరోయిన్ల ఫొటోల్లో, రవివర్మ వేసిన చిత్రాల్లో ముఖాలను మార్చి తమ ముఖాలు పెట్టుకుని...సరదాగా ఫేస్బుక్లో పెట్టుకోవడం ఇప్పుడు ట్రెండ్. ఆ మధ్య పుట్టినరోజు నాడు సినిమా హీరో మన పేరుతో ప్రత్యేకంగా శుభాకాంక్షలు చెప్పడం క్రేజ్ అయింది. కొన్ని కంపెనీలుఆ పద్ధతిలోనే ఏకంగా ప్రకటనలూ తయారుచేశాయి. ‘ఫలానా బట్టల షాపులో ఫ్యాషనబుల్ దుస్తులు దొరుకుతాయి తెలుసా’ అంటూ షారుఖ్ ఖాన్ చెబుతుంటే ఎవరికి మాత్రం నచ్చదూ. అవన్నీ డీప్ఫేక్ సాంకేతికతతో తయారుచేసిన వీడియోలే. 2020 దిల్లీ అసెంబ్లీ ఎన్నికలప్పుడు ఒకపార్టీ అభ్యర్థి తన ప్రత్యర్థి హిందీ వీడియో సంపాదించి దాని ఆధారంగా ఇతర భాషల్లో వ్యతిరేకార్థం వచ్చే మాటలతో నకిలీది తయారుచేసి వాట్సప్ గ్రూపులద్వారా వైరల్ చేశారు. అది చూసినవాళ్లంతా నిజమేనని నమ్మి అతడిని ఓడించారు.

అసలీ ‘డీప్ఫేక్ ఏఐ’ అనేది కొత్త సాంకేతికతే అయినప్పటికీ ఇది ఉన్నపళాన ఆకాశాన్నుంచి ఊడిపడిందేమీ కాదు. ఫొటోలకు మెరుగులు దిద్దడానికి వచ్చిన ఫొటోషాప్ దీనికి మొదటిదశ అనుకుంటే; రోజురోజుకీ పెరుగుతున్న కంప్యూటర్ టెక్నాలజీ, అందుబాటులోకి వస్తున్న బోలెడంత సమాచారం(డేటా), సర్వ సాధారణమైపోయిన కృత్రిమమేధ, మెషీన్ లెర్నింగ్ సాంకేతికతలూ ఒకదానికొకటి జత అవుతూ డీప్ఫేక్ దాకా వచ్చాయన్నమాట.

డీప్ఫేక్ తయారీకి మూలం అనదగ్గ ‘జనరేటివ్ అడ్వర్సోరియల్ నెట్వర్క్- జిఏఎన్’ సాంకేతికతను 2014లో యూని వర్సిటీ ఆఫ్ మాంట్రియల్కి చెందిన పరిశోధకుడు ఇయాన్ గుడ్ఫెలో అభివృద్ధి చేశాడు. 2017లో హాలీవుడ్ నటి గాల్ గాడట్కి సంబంధించిన మొట్టమొదటి నకిలీ అశ్లీల వీడియో సోషల్ నెట్వర్క్ సైట్లో కన్పించింది. వేరొకరి వీడియోకి ఆమె ముఖాన్ని చేర్చారు. 2019లో అలాంటివి 15వేల డీప్ఫేక్ వీడియోలు బయటకు వచ్చాయి. అందులో 96 శాతం పోర్న్ వీడియోలే. మరో ఏడాదికల్లా ఆ సంఖ్య50 వేలకు పెరిగింది. తర్వాత చైనాలోఒక ఆప్(జావో)నే తయారుచేశారు. దాంతో ఎవరైనా తమ ముఖాలను ప్రఖ్యాత నటుల ముఖాలపైన సూపర్ ఇంపోజ్ చేసుకోవచ్చు.

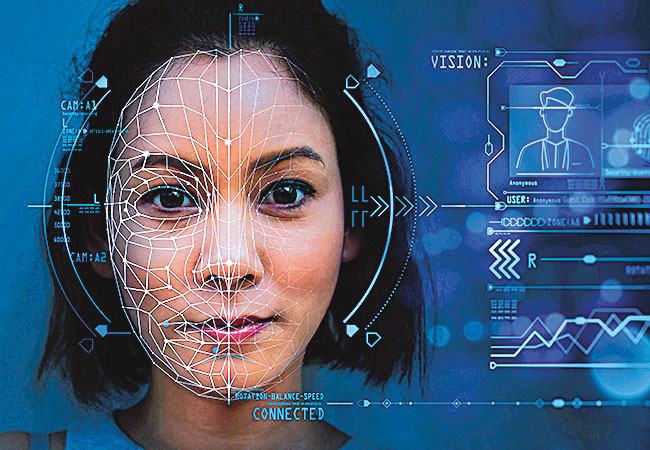

అసలేమిటీ డీప్ఫేక్?

ఒకప్పుడు ఫొటోలను మార్ఫింగ్ చేసి నకిలీవి తయారుచేసేవారు. ఇప్పుడు మరో అడుగు ముందుకేసి కృత్రిమమేధ సాయంతో మరింత మెప్పించేలా, అచ్చంగా ఒరిజినల్ అన్పించేలా నకిలీ వాటిని తయారు చేస్తున్నారు. ఈ పనికి అవసరమైన టెక్నాలజీ, దాని ఫలితంగా వెలువడే బోగస్ కంటెంట్... రెండూ స్ఫురించేలా దీన్ని ‘డీప్ఫేక్’ అంటున్నారు. దీంతో ఫొటోలూ వీడియోలూ ఆడియోలూ... నకిలీవి తయారుచేయొచ్చు. కొన్ని అసలు వాటిని మరిపిస్తే కొన్ని కొత్త కంటెంట్ని సృష్టిస్తున్నాయి. ఫలితంగా- ఒక వ్యక్తి లేనిచోట ఉన్నట్లు, చేయని పని చేసినట్లు, అనని మాటలు అన్నట్లు... కంటెంట్ బయటకు వచ్చి,సదరు వ్యక్తికి తెలియకుండానే వ్యాపిస్తుంది. దాంతో ఆ సమాచారంలోని అంశానికి అతడు బాధ్యత వహించాల్సివస్తుంది. గతేడాది ఉక్రెయిన్ యుద్ధం తీవ్రంగా జరుగుతున్నప్పుడు ఆ దేశ అధ్యక్షుడు జెలెన్స్కీ తమ సైన్యాన్ని లొంగిపొమ్మని ఆదేశిస్తున్నట్లు వచ్చిన వీడియో సంచలనం సృష్టించింది.

ఎలా పనిచేస్తుంది?

దీనికి రెండు అల్గారిథమ్స్ చాలు... తయారుచేయడానికి ఒక జనరేటర్, దానికి మెరుగులు దిద్దడానికి ఒక డిస్క్రిమినేటర్. అందుబాటులో ఉన్న డేటా ఆధారంగా కావలసిన కంటెంట్ని జనరేటర్ తయారు చేస్తుంది. రెండోది అసలుతో పోలుస్తూ దానిలోని లోపాలను వెతికి చెబుతుంది. జనరేటర్ ఆ లోపాలను సరిచేస్తుంది. ఇలా పలుదశల్లో ఇవి మళ్లీ మళ్లీ పనిచేసి అచ్చంగా అసలులా కనిపించే నకిలీని తయారుచేస్తాయి. పై రెండు అల్గారిథమ్స్ని ఉపయోగించుకుని ‘జనరేటివ్ అడ్వర్సోరియల్ నెట్వర్క్... జీఏఎన్’ ఒక న్యూరల్ నెట్వర్క్ని తయారుచేస్తుంది. ఆ తర్వాత ఫేషియల్ రికగ్నిషన్, ఇతర కదలికలను గుర్తించడానికి ‘కన్వల్యూషనల్ న్యూరల్ నెట్వర్క్స్- సీఎన్ఎన్’ని వాడతారు. ముఖంలో హావభావాలూ శరీర కదలికల్నీ మార్చడానికి ఉపయోగపడే ‘ఆటోఎన్కోడర్స్’ సాంకేతికతతో వీడియోలో ఆ మార్పుల్ని చేస్తారు. డీప్ఫేక్ ఆడియో సృష్టించడానికి వాడేదాన్ని ‘నేచురల్ లాంగ్వేజ్ ప్రాసెసింగ్- ఎన్ఎల్పి’ అంటారు. డీప్ఫేక్ తయారీకి ఉత్తమ సామర్థ్యమున్న హై పెర్ఫామెన్స్ కంప్యూటింగ్ వ్యవస్థ కావాలి. ‘ఇన్క్రీజింగ్ త్రెట్ ఆఫ్ డీప్ఫేక్ ఐడెంటిటీస్’ నివేదిక ప్రకారం డీప్ ఆర్ట్ ఎఫెక్ట్, డీప్స్వాప్, డీప్ వీడియో పోర్ట్రెయిట్స్, ఫేస్ఆప్, ఫేస్ మ్యాజిక్, మైహెరిటేజ్, వేవ్టులిప్, వోంబో, జావో లాంటి టూల్స్ సాయంతో సెకన్ల వ్యవధిలోనే డీప్ఫేక్స్ తయారైపోతున్నాయట.అయితే ఈ సాంకేతికత వల్ల లాభాలూ నష్టాలూ కూడా చాలానే ఉన్నాయి.

లాభాలా..?

విద్యా, వైద్య రంగాలతో పాటు ఎంటర్టైన్మెంట్ ఆడియో, వీడియో కంటెంట్ తయారీలో దీన్ని చట్టబద్ధంగా వినియోగించవచ్చు.

కళలు: ప్రఖ్యాత కళారూపాలకు నకిలీలు తయారుచేసి పాపులర్ చేశారు. రవివర్మ, వాన్గో చిత్రాలు ఇప్పుడు పలుచోట్ల కన్పిస్తున్నాయి. సినిమాల్లో సబ్టైటిల్స్కీ డబ్బింగ్కీ దీన్ని ఎక్కువగా వినియోగించవచ్చట. ఇటీవల ఒక నృత్యంలో తమన్నా స్థానంలో సిమ్రన్ని పెట్టిన వీడియో,‘ద గాడ్ఫాదర్’ సినిమాకి చెందిన ప్రఖ్యాత దృశ్యంలో ముగ్గురు ప్రముఖ మలయాళ నటుల్ని పెట్టిన వీడియో వైరల్ అయ్యాయి. సినిమాల పోస్ట్ ప్రొడక్షన్ పని తేలికగా, త్వరగా, చౌకగా అవడానికి ఈ సాంకేతికత ఉపయోగించవచ్చని చెప్పడం తమ ఉద్దేశమని సిమ్రన్ వీడియో తయారుచేసిన ఏఐ స్టార్టప్ ప్రకటించింది. గాడ్ఫాదర్ వీడియో రూపొందించిన టామ్ ఆంటోనీ మాత్రం ఇది ఎంత ప్రమాదకరమైనదో చెప్పడానికే చేశాననీ, ఇంకెప్పుడూ వ్యక్తుల అనుమతి తీసుకోకుండా ఇలాంటి ప్రయోగాలు చేయననీ ప్రకటించాడు.

కాలర్ రెస్పాన్స్ సర్వీసెస్: మనిషి లేకుండా ఆటోమేటిగ్గా అందించే రిసెప్షనిస్టు సేవల్లో భాగంగా ఫోను చేసినవారికి పర్సనలైజ్డ్ సమాధానాలు ఇవ్వడానికిఈ సాంకేతికతను వాడతారు.

కస్టమర్ ఫోన్ సపోర్ట్: కొన్నిచోట్ల ఫిర్యాదు నమోదు చేసుకోవడానికీ, ఖాతాల్లో బ్యాలన్స్ చెక్ చేసుకోవడానికీ ఫోన్ చేస్తే ఎగ్జిక్యూటివ్ గొంతు విన్పిస్తుంది. అది డీప్ఫేక్తో తయారైందే.

వినోదం: సినిమాల్లో, వీడియో గేముల్లో కొందరు నటుల గొంతులకు నమూనా (క్లోన్)ని తయారుచేసి కొన్ని దృశ్యాలకు వాడాల్సి వస్తుంది. ఆయా నటులు అందుబాటులో లేనప్పుడు, ఆ దృశ్యాలను మళ్లీ మళ్లీ చిత్రించడం కష్టమైనప్పుడూ, సమయాన్ని ఆదా చేయడానికీ... అలా చేస్తుంటారు. వ్యంగ్య రచనలకీ డీప్ఫేక్ వీడియోల్ని వాడతారు.

వైద్యశిక్షణ: కొన్నిరకాల వ్యాధులగురించి వైద్యులకు శిక్షణ ఇవ్వడానికిరోగుల వ్యక్తిగత గోప్యతకు ఇబ్బంది కలగకుండా ఈ వీడియోలను ఉపయోగించవచ్చు. క్యాన్సర్ లాంటి వ్యాధులబారిన పడి గొంతు పోగొట్టుకున్నవారికి వాయిస్ క్లోనింగ్తో అవసరమైన చోట అతని గొంతువిన్పించేలా చేయవచ్చు.

మ్యూజియంలూ గ్యాలరీల్లో: పురాతన వస్తువులు ప్రదర్శించే ఈ ప్రదేశాలను డీప్ఫేక్ టెక్నాలజీతో ఆకర్షణీయంగా మార్చవచ్చు... సాలార్జంగో, కృష్ణదేవ రాయలో వీడియోలో కన్పించి తమ గురించి తాము చెప్పుకుంటారన్నమాట.

మరి నష్టాలో..?

లాభాలకన్నా ఈ నష్టాల వల్లే డీప్ఫేక్ అన్నమాట ఇప్పుడు సాధారణ ప్రజలకీ తెలిసింది. దీనివల్ల...

వ్యక్తిగతంగా: అసభ్యంగా, అశ్లీలంగా చిత్రించి వాటిని బహిరంగ పరచకుండా ఉండాలంటే డబ్బో మరోటో కావాలని బేరమాడడం, చెప్పకుండాబహిరంగపరచి పరువు ప్రతిష్ఠలకి భంగం కలిగించడం... లాంటి చర్యలవల్ల ఇబ్బంది పడాల్సివస్తుంది.

సామాజికంగా: సమాజంలో దేన్ని నమ్మాలో దేన్ని నమ్మకూడదో తెలియని అయోమయం ఏర్పడుతుంది. ఫొటోలనూ గొంతులనూ మార్చి న్యాయస్థానాల్లోతప్పుడు సాక్ష్యాలుగా ఉపయోగిస్తే ఏది అసలో ఏది నకిలీనో తేల్చడం కష్టమైపోతుంది.

రాజకీయంగా: వేర్వేరు సందర్భాల్లో మాట్లాడిన మాటల్నీ, తీసిన వీడియోల్నీ జతకూర్చి వ్యతిరేక అర్థం వచ్చేలా వీడియోలు రూపొందించడం వల్ల ప్రజల మధ్య భేదాభిప్రాయాలు సృష్టించడం తేలికవుతోంది. ఇది ఓటింగ్ సరళినీ ప్రభావితం చేస్తోంది.

ఆర్థికంగా: వ్యక్తులూ సంస్థలూ ప్రభుత్వాలూ కూడా డీప్ఫేక్ బాధితులు కావచ్చు. సైబర్క్రైమ్స్ బారిన పడొచ్చు. కార్డుల్ని క్లోన్ చేసి ఆర్థికమోసాలుచేయొచ్చు. పరిచయస్తుల గొంతుతోడబ్బు అడగవచ్చు. స్టాక్ మ్యానిపులేషన్కీ ఇది సాధనంగా మారింది. వివాదాస్పద వ్యాఖ్యలతో ఫేక్ వీడియో సృష్టించి విడుదలచేయడంతో ఒక్కసారిగాషేర్లు కుప్పకూలుతున్నాయి. 2019లోయూకేలో ఒక కంపెనీ సీఈఓ గొంతుతో సంస్థ ప్రధాన కార్యాలయానికి ఫోన్చేసి అర్జెంటుగా రెండుకోట్ల రూపాయల్నిఒక ఎకౌంట్కి బదిలీ చేయమనిఅడిగారు. సీఈఓ స్వయంగా చెబితే కాదనేదెవరు... చేసేశారు. కొన్నాళ్లకు కానీ మోసపోయామని తెలియలేదు. జపాన్ కంపెనీ ఒకటి డీప్ఫేక్ స్కామ్లోరూ.316 కోట్లు నష్టపోయింది.

ఎవరు చేస్తారు?

కొత్త సాంకేతికత అందుబాటులోకి వస్తే ప్రయోగాలు చేయడం కొందరికి సరదా. అవి ప్రజల్లోకి వెళ్లి అందరూ చూస్తుంటే మరింత ఉత్సాహంగా చేస్తారు. కొన్ని వెబ్సైట్స్ ప్రజాదరణ పొందడానికి ఇలాంటి డీప్ఫేక్ వీడియోలను పోస్ట్ చేస్తాయి. అవే నేరస్థుల్ని పోషిస్తాయి. యు.ఎస్.డిపార్ట్మెంట్ ఆఫ్ హోమ్లాండ్ సెక్యూరిటీ నివేదిక ప్రకారం భవిష్యత్తులో టెక్ట్స్ మెసేజ్లు కూడా డీప్ఫేక్ బారిన పడనున్నాయట. సాధారణంగా ఒక వ్యక్తి సందేశాలు రాసే శైలిని బట్టి అతనికి తెలియకుండా అతని నుంచి సందేశాలు ఇతరులకు పంపే ప్రమాదం ఉందట.

కనిపెట్టలేమా?

నిశితంగా పరిశీలిస్తే నిపుణులు డీప్ఫేక్ కంటెంట్ని కనిపెట్టగలరు కానీ అందరికీ సాధ్యం కాదు.బీ ముఖం పొజిషన్ అసాధారణంగా, శరీర కదలికలూ రంగులూ అసహజంగా ఉండవచ్చు.

- ఆడియోలో నిలకడ ఉండదు. మాట బ్రేక్ అవుతుంది. ఆడియోకి తగినట్లుగా పెదవుల కదలిక ఉందా, గొంతు అతని దేనా... అనీ చూడాలి.బీ వీడియోలను జూమ్ చేసి చూస్తే వెలుగునీడలు అసాధారణంగా కన్పిస్తాయి. బ్యాక్గ్రౌండ్లోనో, చుట్టుపక్కల వస్తువులో బ్లర్ అయివుంటాయి.

- వీడియోల్లో కనురెప్పల కదలిక సహజంగా ఉండదు. అలాగే నేరుగా కళ్లలోకి చూసి మాట్లాడుతున్నారా లేదా కూడా గమనించొచ్చు.

- సందేశాల్లో స్పెలింగ్ తప్పులుంటాయి, వాక్యాలు సదరు వ్యక్తి మాట్లాడే, రాసే శైలికి భిన్నంగా, అసందర్భ ప్రస్తావనలుంటాయి.

- ఈ మెయిల్ అడ్రసులు కూడా అనుమానాస్పదంగా ఉంటాయి.

అయితే కృత్రిమమేధతో ఈ లోపాలను అధిగమించే ప్రయత్నాలూ జరుగుతున్నాయి కాబట్టి రాను రాను వీటిని కనిపెట్టడం ఇంకా కష్టమే అవుతుంది. టెక్ సంస్థలూ, ప్రభుత్వ విభాగాలూ డీప్ఫేక్ కంటెంట్ని కనిపెట్టి, బ్లాక్ చేయగల సాంకేతికతను అభివృద్ధి చేసే ప్రయత్నాల్లో ఉన్నాయి. సోషల్ మీడియా యాజమాన్యాలు కొన్ని- తమ వేదికల మీద పోస్ట్ చేసే ఫొటోలూ వీడియోలూ అసలువా నకిలీవా అని గుర్తించడానికి బ్లాక్చైన్ టెక్నాలజీని వాడు తున్నాయి. అడోబ్, మైక్రోసాఫ్ట్ లాంటివి అందుకు తగిన సాఫ్ట్వేర్ని తయారు చేసుకున్నాయి. ఐఐటీ రోపార్, ఆస్ట్రేలియా లోని మోనాష్ యూనివర్సిటీ నిపుణులు కలిసి ‘ఫేక్ బస్టర్’ పేరుతో ఫేక్ వీడియోలను కనిపెట్టే సాంకేతికతను అభివృద్ధిచేశారు.

చట్టం సాయపడదా?

ఈ నేరానికి మనదేశంలో ప్రత్యేకంగా చట్టమేమీ లేదు. ఐటీ చట్టంలోని సెక్షన్లు 66డి, 67, 67ఎ కింద కంప్యూటరు ఉపయోగించి మోసంచేయడం, వ్యక్తిగత ప్రతిష్ఠకు భంగం కలిగించడం అనే నేరాలకు జైలు శిక్ష, భారీ జరిమానాలూ విధించవచ్చు. ఐపీసీ సెక్షన్ 500 కింద పరువునష్టం కలిగించినందుకు శిక్షించవచ్చు. 2019లో ప్రవేశపెట్టిన పర్సనల్ డేటా ప్రొటెక్షన్ బిల్లు కూడా ఆమోదం పొందితే వ్యక్తిగత సమాచారానికి రక్షణ లభిస్తుంది. తాజా సంఘటనల నేపథ్యంలో కేంద్రం సోషల్ మీడియా వేదికలకు కఠినమైన ఆదేశాలను జారీచేసింది. ఎవరైనా డీప్ఫేక్ కంటెంట్ గురించి ఫిర్యాదు చేస్తే 36 గంటల్లోగా వాటిని తీసెయ్యాలి. అలా తీసేయడంలో విఫలమైతే ఆయా వేదికలను నిషేధిస్తారు. డీప్ఫేక్ సృష్టికర్తలకు మూడేళ్ల జైలు,లక్ష రూపాయల జరిమానా విధించవచ్చు.కూరలు కోసే కత్తి ప్రాణాలూ తీయగలదు. అందుకే దాంతో జాగ్రత్తగా ఉంటాం తప్ప ఉపయోగించకుండా వదిలెయ్యం. సాంకేతికతా అలాంటిదే. దాని ప్రయోజనాలను అందుకుంటూనే మోసగాళ్లకు దొరకకుండా అప్రమత్తంగా ఉండాలి మరి..!

జాగ్రత్తపడదాం..!

డీప్ఫేక్ బారిన పడకుండా ఉండాలంటే ఎవరికివారే కొన్ని జాగ్రత్తలు తీసుకోవాలి.ఆ మధ్య కేరళలో ఒక సంఘటన జరిగింది. ఒక టీనేజ్ కుర్రాడి నుంచి తండ్రికి ఫోన్ వచ్చింది. తనకి యాక్సిడెంట్ అయిందనీ, ఫోన్ పగిలిపోతే వేరే వాళ్ల ఫోన్ నుంచి చేస్తున్నాననీ, ఆస్పత్రికి అర్జెంటుగా కట్టాలి కాబట్టి ముందు ఫోన్పేలో ఆ నంబరుకి 40 వేలు డబ్బు పంపించమనీ అడిగాడు. తండ్రి కంగారుపడి వెంటనే డబ్బు పంపించి తర్వాత ఆస్పత్రికెళ్తే అక్కడెవరూ లేరు. కొడుకు కాలేజీలో ఉన్నాడు. ఆ అబ్బాయి గొంతును క్లోన్ చేసి చేసిన మోసం అది. అలాంటి మోసాలకు బాధితులు కాకూడదనుకుంటే ప్రతి కుటుంబమూ ఒక కోడ్ వర్డ్ పెట్టుకోవాలనీ ఫోనుల్లో మాట్లాడేటప్పుడు దాన్ని ఉచ్చరించాలనీ సూచిస్తున్నారు నిపుణులు. ఇంకా...

- ఒక వీడియో అయినా, ఫొటో అయినా, ప్రసంగమైనా చూడగానే నిజమని నమ్మేయొద్దు. నిశితంగా పరిశీలించాలి. అది నమ్మదగిన వ్యక్తుల నుంచే వచ్చిందా- అన్నది చూడాలి.

- ఫేక్ కంటెంట్ అని అనుమానం ఉన్న దేన్నీ ఇతరులకు ఫార్వర్డ్ చేయకూడదు. వెంటనే తొలగించాలి.

- అపరిచితుల వీడియో కాల్స్ అస్సలు ఆన్సర్ చేయకూడదు. వ్యక్తిగత ఆడియో, వీడియో ఫైల్స్ని బయటి వారికి పంపకూడదు.

- ఫోన్కాల్స్ కూడా ఎంత సన్నిహితులదైనా గొంతును గమనించాలి. ఏమాత్రం తేడా ఉన్నా అనుమానించాలి. అప్పటికి ఫోన్ పెట్టేసి కాసేపయ్యాక కాల్ చేసి చూడాలి.

- బ్యాంకు ఖాతాలకు సంబంధించీ, ఆర్థిక విషయాలకు సంబంధించీ... ఏ సమాచారాన్నీ ఫోనులో ఎవరికీచెప్పకూడదు. నిజానిజాలు నిర్ధారించుకోకుండా ఎవరికీ డబ్బు పంపకూడదు.

- పై అధికారుల పేరుతో వచ్చే సందేశాలనూ మెయిల్స్నూ జాగ్రత్తగా పరిశీలించాలి. మెయిల్ అడ్రస్ క్రాస్చెక్ చేసుకోవాలి.

- వీడియో మీటింగులతో వ్యాపార నిర్ణయాలూ లావాదేవీలు జరపకూడదు. ప్రాథమిక చర్చ అక్కడ జరిపినా తుదినిర్ణయానికి ప్రత్యక్ష సమావేశమే మంచిది.

- సోషల్మీడియాలో ఫోటోలు షేర్ చేస్తున్నప్పుడు ఎంతో జాగ్రత్తగా ఉండాలి. గ్రూప్ ఫొటోల వరకే షేర్ చేయడం మంచి పద్ధతి. వ్యక్తిగత ఫొటోలకు ప్రైవసీ సెట్టింగులు ఉండాలి.

- వాడే గ్యాడ్జెట్స్ అన్నిటికీ సెక్యూరిటీ సెట్టింగ్స్ పెట్టుకోవాలి.

గమనిక: ఈనాడు.నెట్లో కనిపించే వ్యాపార ప్రకటనలు వివిధ దేశాల్లోని వ్యాపారస్తులు, సంస్థల నుంచి వస్తాయి. కొన్ని ప్రకటనలు పాఠకుల అభిరుచిననుసరించి కృత్రిమ మేధస్సుతో పంపబడతాయి. పాఠకులు తగిన జాగ్రత్త వహించి, ఉత్పత్తులు లేదా సేవల గురించి సముచిత విచారణ చేసి కొనుగోలు చేయాలి. ఆయా ఉత్పత్తులు / సేవల నాణ్యత లేదా లోపాలకు ఈనాడు యాజమాన్యం బాధ్యత వహించదు. ఈ విషయంలో ఉత్తర ప్రత్యుత్తరాలకి తావు లేదు.

మరిన్ని

ఇంకా..

తాజా వార్తలు (Latest News)

-

కోనసీమ జిల్లాలో ఘోర ప్రమాదం.. నలుగురు కూలీలు మృతి

-

ఆగని బెదిరింపు మెయిల్స్.. తాజాగా తిహాడ్ జైలుకు!

-

ఎయిర్టెల్ లాభం 31% డౌన్.. కొత్తగా 78 లక్షల మంది కస్టమర్లు

-

బికినీలో అనన్య పాండే.. కాబోయే భర్తతో వరలక్ష్మి ఫొటో

-

అమెరికాలో చైనా ‘సైన్యం’.. ట్రంప్ ప్రచారంపై రచ్చ!

-

ఆ వీడియోల లీక్ వెనక ‘భారీ తిమింగలం’ - కుమారస్వామి ఆరోపణ